El ejército israelí ha marcado a decenas de miles de habitantes de Gaza como sospechosos de asesinato, utilizando un sistema de selección de objetivos de IA con poca supervisión humana y una política permisiva en cuanto a las bajas, revelan +972 y Local Call.

En 2021 se publicó en inglés un libro titulado: “El equipo humano-máquina: cómo crear una sinergia entre la inteligencia humana y la artificial que revolucionará nuestro mundo”, con el seudónimo de “Brigadier General YS”. En el libro, el autor -un hombre que confirmamos que es el actual comandante de la unidad de élite de inteligencia israelí 8200– justifica el diseño de una máquina especial que podría procesar rápidamente cantidades masivas de datos para generar miles de “objetivos” potenciales para ataques militares en el fragor de una guerra. Tal tecnología, escribe, resolvería lo que describió como un “cuello de botella humano tanto para localizar los nuevos objetivos como para la toma de decisiones para aprobarlos”.

Resulta que una máquina así realmente existe. Una nueva investigación de +972 Magazine y Local Call revela que el ejército israelí ha desarrollado un programa basado en inteligencia artificial conocido como “Lavender”, presentado aquí por primera vez. Según seis oficiales de inteligencia israelíes, que sirvieron en el ejército durante la actual guerra en la Franja de Gaza y estuvieron involucrados de primera mano con el uso de IA para generar objetivos para el asesinato, Lavender ha desempeñado un papel central en el bombardeo sin precedentes de palestinos, especialmente durante las primeras etapas de la guerra. De hecho, según las fuentes, su influencia en las operaciones militares fue tal que esencialmente trataron los resultados de la máquina de IA «como si fueran una decisión humana».

Formalmente, el sistema Lavender está diseñado para marcar a todos los agentes sospechosos de los grupos militares de Hamás y la Jihad Islámica Palestina (PIJ), incluidos los de bajo rango, como posibles objetivos de bombardeo. Las fuentes dijeron a +972 y Local Call que, durante las primeras semanas de la guerra, el ejército dependió casi por completo de Lavender, que registró hasta 37.000 palestinos como presuntos militantes (y sus hogares) para posibles ataques aéreos.

Durante las primeras etapas de la guerra, el ejército aprobó que los oficiales adoptaran las listas de muerte de Lavender sin necesidad de comprobar minuciosamente por qué la máquina tomó esas decisiones ni de examinar los datos de inteligencia en los que se basaban. Una fuente afirmó que el personal humano a menudo servía sólo como un «sello de goma» para las decisiones de la máquina, añadiendo que, normalmente, dedicaban personalmente sólo unos «20 segundos» a cada objetivo antes de autorizar un bombardeo, sólo para asegurarse de que el objetivo marcado por Lavender era un hombre. Esto lo hicieron, incluso sabiendo que el sistema comete “errores” en aproximadamente el 10 por ciento de los casos, y se sabe que ocasionalmente marca a personas que tienen simplemente una conexión vaga con grupos militantes, o ninguna conexión en absoluto.

Además, el ejército israelí atacó sistemáticamente a las personas objetivo mientras se encontraban en sus hogares (normalmente de noche, mientras toda su familia estaba presente) y no durante el curso de la actividad militar. Según las fuentes, esto se debió a que, desde el punto de vista de inteligencia, era más fácil localizar a las personas en sus casas particulares. Además tenian otros sistemas automatizados como uno llamado «¿Dónde está papá?» que se utilizaron específicamente para rastrear a los individuos objetivo y llevar a cabo atentados con bombas cuando entraban en las residencias de sus familias.

El resultado, como testificaron las fuentes, es que miles de palestinos (la mayoría de ellos mujeres y niños o personas que no participaron en los combates) fueron aniquilados por los ataques aéreos israelíes, especialmente durante las primeras semanas de la guerra, debido a las decisiones del programa de IA.

«No estábamos interesados en matar a los agentes [de Hamás] sólo cuando estaban en un edificio militar o participando en una actividad militar», dijo A., un oficial de inteligencia, a +972 y Local Call. “Por el contrario, el ejercito israeli bombardeó sus casas sin dudarlo, como primera opción. Es mucho más fácil bombardear la casa de una familia. El sistema está diseñado para buscarlos en estas situaciones”.

La máquina Lavender se une a otro sistema de inteligencia artificial, “The Gospel”, sobre el cual se reveló información en una investigación previa de +972 y Local Call en noviembre de 2023, así como en las propias publicaciones del ejército israelí . Una diferencia fundamental entre los dos sistemas está en la definición del objetivo: mientras que The Gospel marca los edificios y estructuras desde los que el ejército afirma que operan los militantes, Lavender marca a las personas y las pone en una lista de asesinables.

Además, según las fuentes, cuando se trataba de atacar a supuestos militantes jóvenes marcados por Lavender, el ejército prefería utilizar únicamente misiles no guiados, comúnmente conocidos como bombas «tontas» (en contraste con las bombas «inteligentes» de precisión), que pueden destruir edificios enteros y causan importantes víctimas. «No conviene desperdiciar bombas caras en gente sin importancia; es muy caro para el país y hay escasez [de esas bombas]», dijo C., uno de los oficiales de inteligencia. Otra fuente dijo que habían autorizado personalmente el bombardeo de “cientos” de casas privadas de presuntos jóvenes marcados por Lavender, y que muchos de estos ataques mataron a civiles y familias enteras que son considerasdos como “daños colaterales”.

En una medida sin precedentes, según dos de las fuentes, el ejército también decidió durante las primeras semanas de la guerra que por cada joven agente de Hamás que Lavender marcara, estaba permitido matar hasta 15 o 20 civiles; En el pasado, los militares no autorizaban ningún “daño colateral” durante los asesinatos de militantes de bajo rango. Las fuentes añadieron que, en el caso de que el objetivo fuera un alto funcionario de Hamás con rango de comandante de batallón o brigada, el ejército autorizó en varias ocasiones el asesinato de más de 100 civiles en el asesinato de un solo comandante.

La siguiente investigación está organizada según las seis etapas cronológicas de la producción de objetivos altamente automatizados por parte del ejército israelí en las primeras semanas de la guerra de Gaza.

Primero, explicamos la propia máquina Lavender, que marcó a decenas de miles de palestinos utilizando IA. En segundo lugar, revelamos la pregunta «¿Dónde está papá?» sistema, que rastreaba estos objetivos y avisaba al ejército cuando entraban en sus hogares familiares. En tercer lugar, describimos cómo se eligieron bombas “tontas” para atacar estas casas. En cuarto lugar, explicamos cómo el ejército aumentaba el número permitido de civiles que podían morir durante el bombardeo de un objetivo. En quinto lugar, observamos cómo el software automatizado calculó de manera incorrecta la cantidad de no combatientes en cada hogar. Y sexto, mostramos cómo en varias ocasiones, cuando una casa fue atacada, generalmente de noche, el objetivo individual a veces no estaba dentro, porque los oficiales militares no verifican la información en tiempo real.

PASO 1: GENERAR METAS

‘Una vez que se vuelve automático, la generación de objetivos se vuelve loca’

En el ejército israelí, el término “objetivo humano” se refería en el pasado a un operativo militar de alto rango que, según las reglas del Departamento de Derecho Internacional del ejército, puede ser asesinado en su casa privada incluso si hay civiles alrededor. Fuentes de inteligencia dijeron a +972 y Local Call que durante las guerras anteriores de Israel, dado que se trataba de una forma “especialmente brutal” de matar a alguien (a menudo matando a una familia entera junto al objetivo), dichos objetivos humanos eran marcados con mucho cuidado y sólo los comandantes militares de alto rango eran identificados y bombardeados en sus hogares, para mantener el principio de proporcionalidad previsto en el derecho internacional.

Pero después del 7 de octubre, cuando militantes liderados por Hamás lanzaron un ataque mortal contra las comunidades del sur de Israel, matando a unas 1.200 personas y secuestrando a 240, el ejército, dijeron las fuentes, adoptó un enfoque dramáticamente diferente. Bajo la “Operación Espadas de Hierro”, el ejército decidió designar a todos los agentes del ala militar de Hamás como objetivos humanos, independientemente de su rango o importancia militar. Y eso cambió todo.

La nueva política también planteó un problema técnico para la inteligencia israelí. En guerras anteriores, para autorizar el asesinato de un único objetivo humano, un oficial tenía que pasar por un complejo y largo proceso de “incriminación”: cotejar pruebas de que la persona era efectivamente un alto miembro del ala militar de Hamás, encontrar y saber dónde vivía, su información de contacto y, finalmente, saber cuándo estaba en casa en tiempo real. Cuando la lista de objetivos incluía sólo unas pocas docenas de agentes de alto rango, el personal de inteligencia podía encargarse individualmente del trabajo involucrado en incriminarlos y localizarlos.

Sin embargo, una vez que la lista se amplió para incluir a decenas de miles de agentes de menor rango, el ejército israelí pensó que tenía que depender de un software automatizado e inteligencia artificial. El resultado, testifican las fuentes, fue que el papel del personal humano en incriminar a los palestinos como agentes militares fue ignorado y la IA hixo la mayor parte del trabajo. Según cuatro de las fuentes que hablaron con +972 y Local Call, Lavender, que fue desarrollado para crear objetivos humanos en la guerra actual, ha marcado a unos 37.000 palestinos como presuntos “militantes de Hamas”, la mayoría de ellos jóvenes para asesinarlos (el portavoz de las FDI negó la existencia de dicha lista de asesinables en una declaración enviada al +972 y a una llamada local).

«No sabíamos quiénes eran los agentes jóvenes, porque Israel no los rastreaba de forma rutinaria [antes de la guerra]», explicó el oficial superior B. al +972 y a Local Call, aclarando la razón de usar la máquina en particular para la guerra actual. “Querían permitirnos atacar [a los agentes jóvenes] automáticamente. Ese es el Santo Grial. Una vez que se vuelve automático, la generación de objetivos se vuelve loca”.

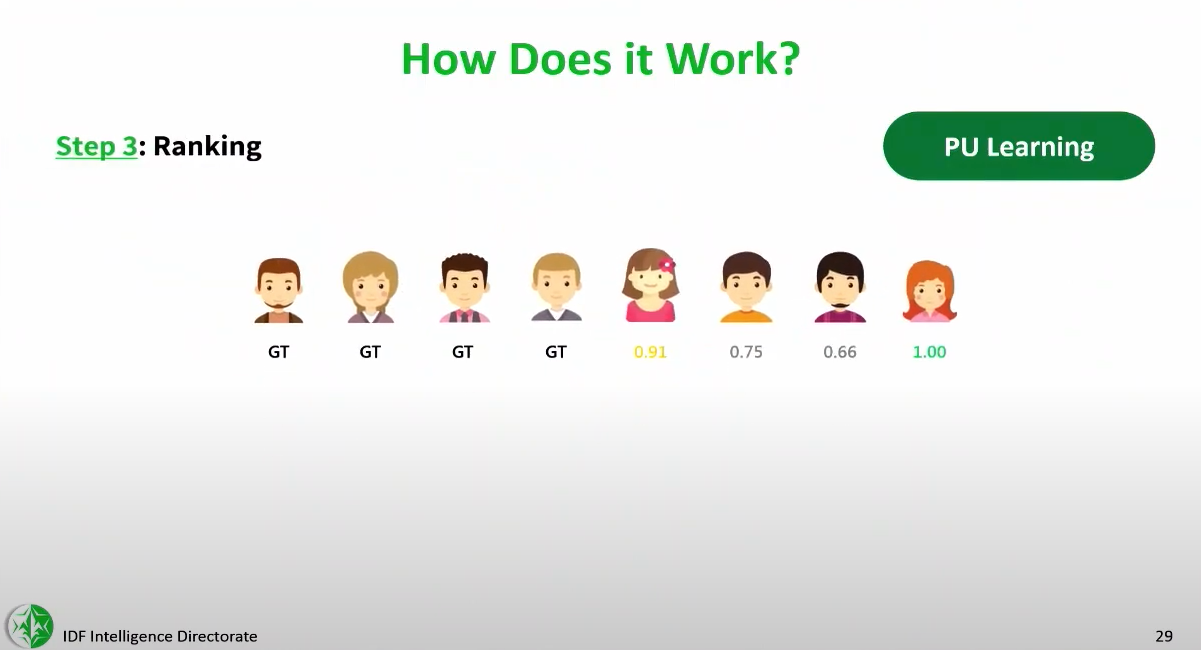

Las fuentes dijeron que la aprobación para adoptar automáticamente las listas de muerte de Lavender, que anteriormente se habían utilizado sólo como herramienta auxiliar, se otorgó aproximadamente dos semanas después de la guerra, después de que el personal de inteligencia verificara «manualmente» la precisión de una muestra aleatoria de varios cientos de objetivos seleccionados por el sistema de IA. Cuando esa muestra descubrió que los resultados de Lavender habían alcanzado un 90 por ciento de precisión en la identificación de la afiliación de un individuo con Hamás, el ejército autorizó el uso generalizado del sistema. A partir de ese momento, las fuentes dijeron que si Lavender decidía que un individuo era militante de Hamas, esencialmente se les pedía que lo trataran como una orden, sin necesidad de verificar de forma independiente por qué la máquina tomó esa decisión o de examinar los datos de inteligencia en bruto en los que se basaba.

“A las 5 de la mañana, [la fuerza aérea] venía y bombardeaba todas las casas que habíamos marcado”, dijo B. “Sacamos a miles de personas. No los revisamos uno por uno: pusimos todo en sistemas automatizados, y tan pronto como uno de [los individuos marcados] estaba en casa, inmediatamente se convertía en un objetivo. Lo bombardeamos a él y a su casa”.

«Para mí fue muy sorprendente que nos pidieran que bombardeáramos una casa para matar a un soldado de tierra, cuya importancia en los combates era tan baja», dijo una fuente sobre el uso de la IA para marcar a presuntos militantes de bajo rango. “A esos objetivos los apodé ‘objetivos basura’. Aún así, los encontré más éticos que los objetivos que bombardeamos sólo por ‘disuasión’ : rascacielos que son evacuados y derribados sólo para causar destrucción”.

Los resultados mortales de esta flexibilización de las restricciones en la primera etapa de la guerra fueron asombrosos. Según datos del Ministerio de Salud palestino en Gaza, del que el ejército israelí ha dependido casi exclusivamente desde el comienzo de la guerra, Israel mató a unos 15.000 palestinos (casi la mitad de la cifra de muertos hasta ahora) en las primeras seis semanas de la guerra, hasta que el 24 de noviembre se acordó un alto el fuego de una semana.

‘Cuanta más información y variedad, mejor’

El software Lavender analiza la información recopilada sobre la mayoría de los 2,3 millones de residentes de la Franja de Gaza a través de un sistema de vigilancia masiva, luego evalúa y clasifica la probabilidad de que cada persona en particular esté activa en el ala militar de Hamas o PIJ. Según las fuentes, la máquina otorga a casi todas las personas en Gaza una calificación del 1 al 100, expresando la probabilidad de que sean militantes.

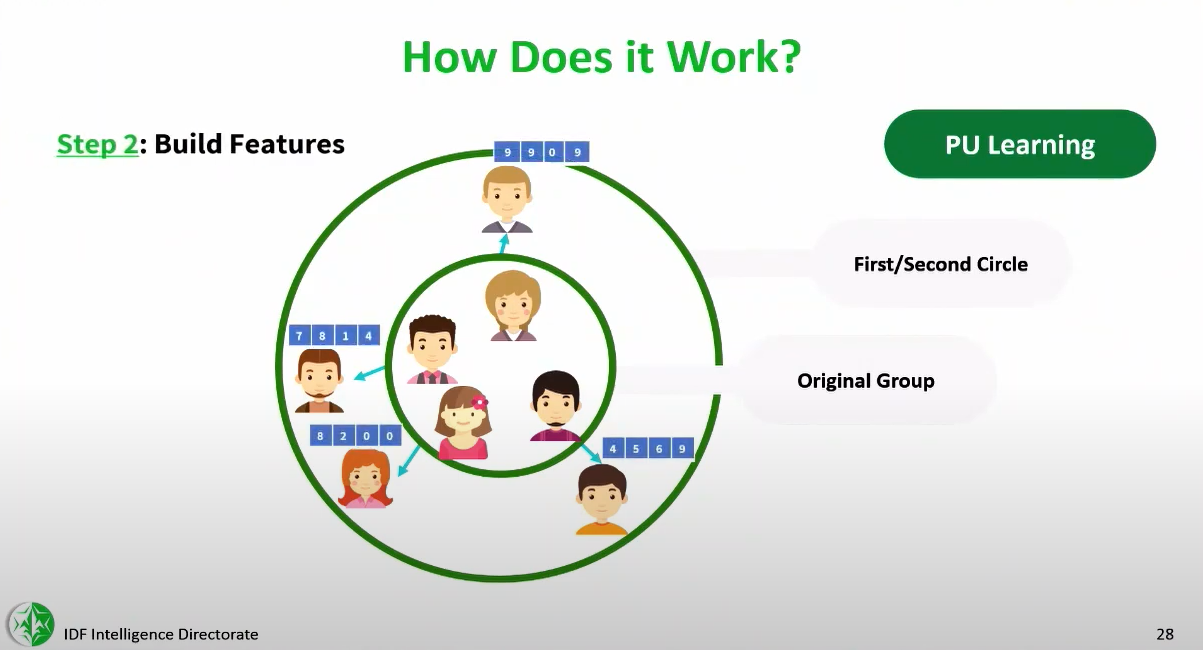

Lavender aprende a identificar características de agentes conocidos de Hamas y PIJ, cuya información fue introducida en la máquina como datos de entrenamiento, y luego a localizar esas mismas características -también llamadas «características»- entre la población general, explicaron las fuentes. Un individuo que tenga varias características incriminatorias diferentes alcanzará una calificación alta y, por lo tanto, automáticamente se convertirá en un objetivo potencial de asesinato.

En “The Human-Machine Team”, el libro al que se hace referencia al principio de este artículo, el actual comandante de la Unidad 8200 aboga por dicho sistema sin hacer referencia a Lavender por su nombre (el comandante en sí tampoco es nombrado, pero cinco fuentes en 8200 confirmaron que el comandante es el autor, como informó también Haaretz). Al describir al personal humano como un “cuello de botella” que limita la capacidad del ejército durante una operación militar, el comandante se lamenta: “Nosotros [los humanos] no podemos procesar tanta información. No importa a cuántas personas se le haya asignado la tarea de producir objetivos durante la guerra: todavía no se pueden producir suficientes objetivos por día”.

La solución a este problema, afirma, es la inteligencia artificial. El libro ofrece una breve guía para construir una «máquina objetivo», similar en descripción a Lavender, basada en inteligencia artificial y algoritmos de aprendizaje automático. En esta guía se incluyen varios ejemplos de los “cientos y miles” de funciones que pueden aumentar la calificación de un individuo, como estar en un grupo de Whatsapp con un militante conocido, cambiar de teléfono celular cada pocos meses y cambiar de dirección con frecuencia.

“Cuanta más información y más variedad, mejor”, escribe el comandante. «Información visual, información celular, conexiones de redes sociales, información del campo de batalla, contactos telefónicos, fotografías». Si bien los humanos seleccionan estas características al principio, continúa el comandante, con el tiempo la máquina llegará a identificar las características por sí sola. Esto, dice, puede permitir a los militares crear “decenas de miles de objetivos”, mientras que la decisión real de atacarlos o no seguirá siendo una decisión humana.

El libro no es la única vez que un alto comandante israelí insinúa la existencia de máquinas objetivo humanas como Lavender. +972 y Local Call obtuvieron imágenes de una conferencia privada impartida por el comandante del centro secreto de ciencia de datos e inteligencia artificial de la Unidad 8200, “Col. Yoav”, en la semana de IA de la Universidad de Tel Aviv en 2023, sobre la cual se informó en ese momento en los medios israelíes.

En la conferencia, el comandante habla de una nueva y sofisticada máquina de objetivos utilizada por el ejército israelí que detecta «personas peligrosas» basándose en su semejanza con las listas existentes de militantes conocidos en los que fue entrenada. “Utilizando el sistema, logramos identificar a los comandantes de los escuadrones de misiles de Hamás”, “Coronel. Yoav”, dijo en la conferencia, refiriéndose a la operación militar de Israel en mayo de 2021 en Gaza, cuando la máquina se utilizó por primera vez.

Las diapositivas de la presentación de la conferencia, también obtenidas por +972 y Local Call, contienen ilustraciones de cómo funciona la máquina: recibe datos sobre los agentes existentes de Hamas, aprende a notar sus características y luego califica a otros palestinos en función de cuán similares son. a los militantes.

“Clasificamos los resultados y determinamos el umbral [al cual atacar a un objetivo]”, “Coronel. Yoav”, dijo en la conferencia, enfatizando que “eventualmente, las decisiones las toman personas de carne y hueso. En el ámbito de la defensa, éticamente hablando, ponemos mucho énfasis en esto. Estas herramientas están destinadas a ayudar [a los oficiales de inteligencia] a romper sus barreras”.

Sin embargo, en la práctica, las fuentes que han utilizado Lavender en los últimos meses dicen que la acción y la precisión humanas fueron sustituidas por la creación masiva de objetivos y la letalidad.

«No hubo una política de ‘error cero'»

B., un oficial superior que usó Lavender, reiteró al +972 y a Local Call que en la guerra actual, los oficiales no estaban obligados a revisar de forma independiente las evaluaciones del sistema de IA, para ahorrar tiempo y permitir la producción en masa de objetivos humanos sin obstáculos. .

«Todo era estadístico, todo estaba ordenado, estaba muy seco», dijo B. Señaló que esta falta de supervisión estaba permitida a pesar de los controles internos que mostraban que los cálculos de Lavender se consideraban precisos sólo el 90 por ciento de las veces; en otras palabras, se sabía de antemano que el 10 por ciento de los objetivos humanos previstos para el asesinato no eran en absoluto miembros del ala militar de Hamás.

Por ejemplo, las fuentes explicaron que la máquina Lavender a veces marcaba erróneamente a personas que tenían patrones de comunicación similares a los operativos conocidos de Hamás o de la Yihad Islámica en Palestina, incluidos trabajadores de la policía y de la defensa civil, familiares de militantes, residentes que casualmente tenían un nombre y apodo idéntico al de un operativo, y habitantes de Gaza que utilizaron un dispositivo que alguna vez perteneció a un operativo de Hamas.

“¿Qué tan cerca tiene que estar una persona de Hamás para ser [considerada por una máquina de inteligencia artificial como] afiliada a la organización?” dijo una fuente que critica la inexactitud de Lavender. “Es un límite vago. ¿Es una persona que no recibe un salario de Hamás, pero les ayuda en todo tipo de cosas, un operativo de Hamás? ¿Alguien que estuvo en Hamás en el pasado, pero que ya no está hoy, es un operativo de Hamás? Cada una de estas características (características que una máquina consideraría sospechosas) es inexacta”.

Existen problemas similares con la capacidad de las máquinas objetivo para evaluar el teléfono utilizado por un individuo marcado para ser asesinado. «En la guerra, los palestinos cambian de teléfono todo el tiempo», dijo la fuente. “La gente pierde el contacto con sus familias, le da su teléfono a un amigo o a su esposa y tal vez lo pierde. No hay manera de confiar al 100 por ciento en el mecanismo automático que determina qué número [de teléfono] pertenece a quién”.

Según las fuentes, el ejército sabía que la mínima supervisión humana no descubriría estos fallos. “No existía una política de ‘error cero’. Los errores se trataron estadísticamente”, dijo una fuente que utilizó Lavender. “Debido al alcance y la magnitud, el protocolo fue que incluso si no estás seguro de que la máquina está bien, sabes que estadísticamente está bien. Así que hazlo”.

«Ha demostrado su eficacia», afirma B., la fuente principal. “Hay algo en el enfoque estadístico que te fija en una determinada norma y estándar. Ha habido una cantidad ilógica de [bombardeos] en esta operación. Esto no tiene paralelo en mi memoria. Y tengo mucha más confianza en un mecanismo estadístico que un soldado que perdió a un amigo hace dos días. Todos los presentes, incluido yo, perdimos gente el 7 de octubre. La máquina lo hizo con frialdad. Y eso lo hizo más fácil”.

Otra fuente de inteligencia, que defendió la dependencia de las listas de asesinatos de sospechosos palestinos generadas por Lavender, argumentó que valía la pena invertir el tiempo de un oficial de inteligencia sólo para verificar la información si el objetivo era un alto comandante de Hamás. «Pero cuando se trata de un militante joven, no conviene invertir mano de obra ni tiempo en él», dijo. “En la guerra, no hay tiempo para incriminar a todos los objetivos. Así que estás dispuesto a aprovechar el margen de error que supone utilizar inteligencia artificial, arriesgándote a sufrir daños colaterales y a la muerte de civiles, y a arriesgarte a atacar por error, y a vivir con ello”.

B. dijo que la razón de esta automatización era un impulso constante para generar más objetivos para matar. “En un día sin objetivos [cuya calificación de características era suficiente para autorizar un ataque], atacamos desde un umbral más bajo. Nos presionaban constantemente: «Tráigannos más objetivos». Realmente nos gritaron. Terminamos [matando] a nuestros objetivos muy rápidamente”.

Explicó que al reducir el umbral de calificación de Lavender, se marcaría a más personas como objetivos. “En su apogeo, el sistema logró generar 37.000 personas como objetivos humanos potenciales”, dijo B. “Pero las cifras cambiaban todo el tiempo, porque depende de dónde se establezca el listón de qué es un operativo de Hamás. Hubo momentos en que un operativo de Hamás se definió de manera más amplia, y luego la máquina comenzó a clasificar a todo tipo de personal de defensa civil, oficiales de policía, sobre quienes sería una vergüenza desperdiciar bombas. Ayudan al gobierno de Hamás, pero en realidad no ponen en peligro a los soldados”.

Una fuente que trabajó con el equipo de ciencia de datos militares que entrenó a Lavender dijo que los datos recopilados de los empleados del Ministerio de Seguridad Interna dirigido por Hamás, a quienes no considera militantes, también se introdujeron en la máquina. «Me molestó el hecho de que cuando Lavender fue entrenado, usaron el término ‘operativo de Hamas’ de manera vaga e incluyeron a personas que eran trabajadores de defensa civil en el conjunto de datos «, dijo.

La fuente agregó que incluso si uno cree que estas personas merecen ser asesinadas, entrenar el sistema en función de sus perfiles de comunicación hizo que Lavender fuera más propenso a seleccionar civiles por error cuando sus algoritmos se aplicaron a la población general. «Dado que se trata de un sistema automático que no es operado manualmente por humanos, el significado de esta decisión es dramático: significa que se incluyen como objetivos potenciales a muchas personas con un perfil de comunicación civil».

‘Sólo comprobamos que el objetivo era un hombre’

El ejército israelí rechaza rotundamente estas afirmaciones. En una declaración al +972 y Local Call, el portavoz del ejército israelí negó el uso de inteligencia artificial para definir objetivos, diciendo que se trata simplemente de “herramientas auxiliares que ayudan a los oficiales en el proceso de incriminación”. La declaración continúa: “En cualquier caso, se requiere un examen independiente por parte de un analista [de inteligencia], que verifique que los objetivos identificados son objetivos legítimos para el ataque, de acuerdo con las condiciones establecidas en las directivas del ejército de Israel y el derecho internacional”.

Sin embargo, las fuentes dijeron que el único protocolo de supervisión humana vigente antes de bombardear las casas de presuntos militantes «jóvenes» marcados por Lavender era realizar una única verificación: garantizar que el objetivo seleccionado por la IA sea un hombre y no una mujer. La suposición en el ejército era que si el objetivo era una mujer, la máquina probablemente había cometido un error, porque no hay mujeres entre las filas de las alas militares de Hamás y la Jihad Islámica.

«Un ser humano tenía que [verificar el objetivo] durante sólo unos segundos», dijo B., explicando que esto se convirtió en el protocolo después de darse cuenta de que el sistema Lavender estaba «haciendo las cosas bien» la mayor parte del tiempo. “Al principio hicimos comprobaciones para asegurarnos de que la máquina no se confundiera. Pero en algún momento confiamos en el sistema automático y sólo comprobamos que [el objetivo] era un hombre, eso fue suficiente. No lleva mucho tiempo saber si alguien tiene voz masculina o femenina”.

Para realizar el control masculino/femenino, B. afirmó que en la guerra actual, “en esta etapa invertiría 20 segundos en cada objetivo y haría docenas de ellos cada día. No tenía ningún valor agregado como ser humano, aparte de ser un sello de aprobación. Ahorró mucho tiempo. Si [el operativo] apareciera en el mecanismo automatizado y comprobara que era un hombre, habría permiso para bombardearlo, y contemplado como daños colaterales”.

En la práctica, las fuentes dijeron que esto significaba que para los hombres civiles marcados por error por Lavender, no existía ningún mecanismo de supervisión para detectar el error. Según B., se producía un error común “si el objetivo [de Hamás] le daba [su teléfono] a su hijo, a su hermano mayor o simplemente a un hombre al azar. Esa persona será bombardeada en su casa con su familia. Esto sucedió a menudo. Estos fueron la mayoría de los errores causados por Lavender”, dijo B.

PASO 2: VINCULACIÓN DE OBJETIVOS CON HOGARES FAMILIARES

‘La mayoría de las personas que mataste eran mujeres y niños’

La siguiente etapa en el procedimiento de asesinato del ejército israelí es identificar dónde atacar los objetivos que genera Lavender.

En una declaración a +972 y Local Call, el portavoz del ejercito de Israel afirmó en respuesta a este artículo que “Hamas coloca sus agentes y activos militares en el corazón de la población civil, utiliza sistemáticamente a la población civil como escudos humanos y lleva a cabo combates desde estructuras civiles, incluidos sitios sensibles como hospitales, mezquitas, escuelas e instalaciones de la ONU. El ejercito de Israel está sujeto al derecho internacional y actúa de acuerdo con él, dirigiendo sus ataques sólo contra objetivos y agentes militares”.

Las seis fuentes con las que hablamos se hicieron eco de esto hasta cierto punto, diciendo que el extenso sistema de túneles de Hamás pasa deliberadamente por debajo de hospitales y escuelas; que los militantes de Hamás utilizan ambulancias para desplazarse; y que innumerables activos militares han sido situados cerca de edificios civiles. Las fuentes argumentaron que muchos ataques israelíes matan a civiles como resultado de estas tácticas de Hamas, una caracterización que, según advierten los grupos de derechos humanos , evade la responsabilidad de Israel de causar las bajas.

Sin embargo, en contraste con las declaraciones oficiales del ejército israelí, las fuentes explicaron que una de las principales razones del número de muertos sin precedentes causado por los actuales bombardeos de Israel es el hecho de que el ejército ha atacado sistemáticamente objetivos en sus hogares privados, junto con sus familias, en parte porque -desde el punto de vista de la inteligencia artificial-, era más fácil marcar las casas unifamiliares mediante sistemas automatizados.

De hecho, varias fuentes subrayaron que, a diferencia de numerosos casos de agentes de Hamás que participaban en actividades militares desde zonas civiles, en el caso de ataques de asesinato sistemáticos, el ejército habitualmente tomaba la decisión de bombardear a sospechosos militantes cuando se encontraban en sus hogares y donde no había ninguna actividad militar. Esta decision, dijeron, era un reflejo de la forma en que está diseñado el sistema de vigilancia masiva de Israel en Gaza.

Las fuentes dijeron a +972 y Local Call que dado que toda persona en Gaza tenía una casa privada con la que podían estar asociados, los sistemas de vigilancia del ejército podían “vincular” fácil y automáticamente a las personas con las casas familiares. Para identificar en tiempo real el momento en que los agentes entran en sus casas, se han desarrollado varios softwares automáticos adicionales. Estos programas rastrean a miles de personas simultáneamente, identifican cuándo están en sus casa y envían una alerta automática al objetivo, quien luego marca la casa para bombardearla. Uno de varios de estos softwares de seguimiento, revelado aquí por primera vez, se llama «¿Dónde está papá?»

«Pones cientos [de objetivos] en el sistema y esperas a ver a quién puedes matar», dijo una fuente con conocimiento del sistema. «Se llama búsqueda amplia: se copian y pegan las listas que produce el sistema de destino».

Los datos también demuestran claramente esta política: durante el primer mes de la guerra, más de la mitad de las víctimas mortales (6.120 personas) pertenecían a 1.340 familias, muchas de las cuales fueron completamente aniquiladas mientras se encontraban dentro de sus hogares, según cifras de la ONU. . La proporción de familias enteras bombardeadas en sus casas en la guerra actual es mucho mayor que en la operación israelí de 2014 en Gaza (que anteriormente fue la guerra más mortífera de Israel en la Franja), lo que sugiere aún más la prominencia de esta política.

Otra fuente dijo que cada vez que disminuía el ritmo de los asesinatos, se agregaban más objetivos a sistemas como ¿Dónde está papá? para localizar a personas que entraron en sus casas y que, por tanto, podrían ser bombardeadas. Dijo que la decisión de quién incluir en los sistemas de seguimiento podría ser tomada por oficiales de rango relativamente bajo en la jerarquía militar.

«Un día, totalmente por mi propia voluntad, agregué alrededor de 1.200 nuevos objetivos al sistema [de seguimiento], porque el número de ataques [que estábamos realizando] disminuyó», dijo la fuente. “Eso tenía sentido para mí. En retrospectiva, parece que tomé una decisión seria. Y esas decisiones no se tomaron a altos niveles”.

Las fuentes dijeron que en las dos primeras semanas de la guerra, inicialmente se introdujeron “varios miles” de objetivos en programas de localización como ¿Dónde está papá? Entre ellos se encontraban todos los miembros de la unidad de fuerzas especiales de élite de Hamás, Nukhba, todos los agentes antitanques de Hamás y cualquiera que entrara en Israel el 7 de octubre. Pero en poco tiempo, la lista de muertos se amplió drásticamente.

«Al final fueron todos [marcados por Lavender]», explicó una fuente. «Decenas de miles. Esto ocurrió unas semanas más tarde, cuando las brigadas [israelíes] entraron en Gaza y ya había menos personas no involucradas [es decir, civiles] en las zonas del norte”. Según esta fuente, Lavender incluso marcó a algunos menores como objetivos de bombardeo. «Normalmente, los agentes tienen más de 17 años, pero esa no era una condición».

Lavender y sistemas como ¿Dónde está papá? se combinaron con efectos mortales, matando a familias enteras, dijeron las fuentes. Agregando un nombre de las listas generadas por Lavender a ¿Dónde está papá? Con el sistema de seguimiento domiciliario, explicó A., la persona marcada sería puesta bajo vigilancia constante y podría ser atacada tan pronto como pusiera un pie en su casa, derrumbando la casa sobre todos los que estuvieran dentro.

“Digamos que calculamos [que hay un] [operativo] de Hamas más 10 [civiles en la casa]”, dijo A.. “Por lo general, estos 10 serán mujeres y niños. De manera tan absurda, resulta que la mayoría de las personas que mataste eran mujeres y niños”.

PASO 3: ELEGIR UN ARMA

‘Normalmente llevábamos a cabo los ataques con “bombas tontas”’

Una vez que Lavender ha marcado un objetivo para el asesinato, el personal del ejército ha verificado que son hombres y el software de seguimiento ha localizado el objetivo en su casa, la siguiente etapa es elegir la munición con la que bombardearlos.

En diciembre de 2023, CNN informó que, según estimaciones de la inteligencia estadounidense, alrededor del 45 por ciento de las municiones utilizadas por la fuerza aérea israelí en Gaza eran bombas “tontas”, que se sabe que causan más daños colaterales que las bombas guiadas. En respuesta al informe de CNN, un portavoz del ejército citado en el artículo dijo: “Como militares comprometidos con el derecho internacional y un código de conducta moral, estamos dedicando grandes recursos a minimizar el daño a los civiles que Hamas ha obligado a asumir el papel de escudos humanos. Nuestra guerra es contra Hamás, no contra el pueblo de Gaza”.

Sin embargo, tres fuentes de inteligencia dijeron a +972 y Local Call que los jóvenes marcados por Lavender fueron asesinados sólo con bombas tontas, con el fin de ahorrar armamento más costoso. La implicación, explicó una fuente, era que el ejército no atacaría a un objetivo menor si viviera en un edificio alto, porque el ejército no quería gastar una “bomba de precisión” más precisa y costosa (con un efecto colateral más limitado) para matarlo. Pero si un objetivo menor vivía en un edificio de sólo unos pocos pisos, el ejército estaba autorizado a matarlo a él y a todos los que estaban en el edificio con una bomba tonta.

“Así ocurrió con todos los objetivos menores”, testificó C., que utilizó varios programas automatizados en la guerra actual. “La única pregunta era: ¿es posible atacar el edificio con daños colaterales? Porque normalmente llevábamos a cabo los ataques con bombas tontas, y eso significaba literalmente destruir toda la casa encima de sus ocupantes. Pero incluso si se evita un ataque, no te importa: inmediatamente pasas al siguiente objetivo. Gracias al sistema, los objetivos nunca terminan. Tienes otros 36.000 esperando”.

PASO 4: AUTORIZAR BAJAS CIVILES

‘Atacamos casi sin considerar daños colaterales’

Una fuente dijo que al atacar a agentes jóvenes, incluidos aquellos marcados por sistemas de inteligencia artificial como Lavender, el número de civiles que se les permitía matar junto a cada objetivo se fijó durante las primeras semanas de la guerra en hasta 20. Otra fuente afirmó que el número fijo fue hasta 15. Estos “grados de daño colateral”, como los llaman los militares, se aplicaron ampliamente a todos los militantes jóvenes sospechosos, dijeron las fuentes, independientemente de su rango, importancia militar y edad, y sin ningún examen específico para sopesar la ventaja militar de asesinarlos frente al daño para los civiles.

Según A., que en la guerra actual era oficial en una sala de operaciones de objetivos, el departamento de derecho internacional del ejército nunca antes había dado una “aprobación tan amplia” a un daño colateral tan alto. «No se trata sólo de que se pueda matar a cualquier persona que sea miliciano de Hamás, lo cual está claramente permitido y es legítimo en términos del derecho internacional», dijo A.. “Pero te dicen directamente: ‘Puedes matarlos junto con muchos civiles’.

“Cada persona que vistió un uniforme de Hamás en el último año o dos podría ser bombardeada con 20 [civiles muertos como] daños colaterales, incluso sin un permiso especial”, continuó A.. «En la práctica, el principio de proporcionalidad no existía».

Según A., ésta fue la política durante la mayor parte del tiempo que estuvo en el cargo. Sólo más tarde los militares redujeron el grado de daño colateral. «En este cálculo, también podrían ser 20 niños para un agente joven… Realmente no era así en el pasado», explicó A.. Cuando se le preguntó sobre el fundamento de seguridad detrás de esta política, A. respondió: «Letalidad».

El grado de daño colateral predeterminado y fijo ayudó a acelerar la creación masiva de objetivos utilizando la máquina Lavender, dijeron las fuentes, porque ahorró tiempo. B. afirmó que el número de civiles que se les permitió matar en la primera semana de la guerra por cada militante joven sospechoso marcado por IA era quince, pero que este número “subía y bajaba” con el tiempo.

“Al principio atacamos casi sin considerar los daños colaterales”, dijo B. sobre la primera semana después del 7 de octubre. “En la práctica, realmente no contabas a las personas [en cada casa que fue bombardeada], porque realmente no podías saber si están en casa o no. Después de una semana, comenzaron las restricciones a los daños colaterales. El número bajó [de 15] a cinco, lo que nos hizo muy difícil atacar, porque si toda la familia estaba en casa, no podíamos bombardearla. Luego volvieron a aumentar el número”.

«Sabíamos que mataríamos a más de 100 civiles»

Las fuentes dijeron a +972 y Local Call que ahora, en parte debido a la presión estadounidense, el ejército israelí ya no genera objetivos humanos en masa para bombardear a jóvenes y sus hogares. El hecho de que la mayoría de las casas en la Franja de Gaza ya hayan sido destruidas o dañadas, y que casi toda la población haya sido desplazada, también afectó la capacidad del ejército para confiar en bases de datos de inteligencia y programas automatizados de localización de viviendas.

E. afirmó que el bombardeo masivo de militantes jóvenes tuvo lugar sólo en la primera o segunda semana de la guerra, y luego se detuvo principalmente para no desperdiciar bombas. «Existe una economía de municiones», afirmó E. “Siempre temieron que hubiera [una guerra] en el norte [con Hezbolá en el Líbano] ya no atacan a este tipo de personas [jóvenes] en absoluto”.

Sin embargo, los ataques aéreos contra altos comandantes de Hamás siguen en curso, y las fuentes dijeron que para estos ataques, el ejército está autorizando el asesinato de “cientos” de civiles por objetivo, una política oficial para la que no existe ningún precedente histórico en Israel, ni siquiera en las recientes operaciones militares estadounidenses.

“En el bombardeo del comandante del Batallón Shuja’iya, sabíamos que mataríamos a más de 100 civiles”, recordó B. sobre un bombardeo del 2 de diciembre que, según el portavoz de las FDI , tenía como objetivo asesinar a Wisam Farhat. “Para mí, psicológicamente, fue inusual. Más de 100 civiles: cruza una línea roja”.

Amjad Al-Sheikh, un joven palestino de Gaza, dijo que muchos de sus familiares murieron en ese bombardeo. Residente de Shuja’iya, al este de la ciudad de Gaza, se encontraba ese día en un supermercado local cuando escuchó cinco explosiones que rompieron los cristales de las ventanas.

«Corrí a la casa de mi familia, pero ya no había edificios allí«, dijo Al-Sheikh al +972 y a Local Call. “La calle se llenó de gritos y humo. Bloques residenciales enteros se convirtieron en montañas de escombros y pozos profundos. La gente empezó a buscar en el cemento con las manos, y yo también, buscando señales de la casa de mi familia”.

La esposa y la hija pequeña de Al-Sheikh sobrevivieron, protegidas de los escombros por un armario que cayó encima de ellas, pero él encontró a otros 11 miembros de su familia, entre ellos sus hermanas, hermanos y sus hijos pequeños, muertos bajo los escombros. Según el grupo de derechos humanos B’Tselem, el bombardeo de ese día destruyó decenas de edificios, mató a decenas de personas y enterró a cientos bajo las ruinas de sus hogares.

«Familias enteras fueron asesinadas»

Fuentes de inteligencia dijeron a +972 y Local Call que participaron en ataques aún más mortíferos. Para asesinar a Ayman Nofal, el comandante de la Brigada Central de Gaza de Hamas, una fuente dijo que el ejército autorizó el asesinato de aproximadamente 300 civiles, destruyendo varios edificios en ataques aéreos en el campo de refugiados de Al-Bureij el 17 de octubre, basándose en una localización imprecisa de Nofal. Imágenes de satélite y vídeos del lugar muestran la destrucción de varios grandes edificios de apartamentos de varias plantas.

“En el ataque fueron arrasadas entre 16 y 18 casas”, dijo Amro Al-Khatib, residente del campamento, a +972 y Local Call. «No podíamos distinguir un apartamento de otro; todos se mezclaron entre los escombros y encontramos partes de cuerpos humanos por todas partes«.

Después, Al-Khatib recordó que se sacaron unos 50 cadáveres de entre los escombros y que unas 200 personas resultaron heridas, muchas de ellas de gravedad. Pero eso fue sólo el primer día. Los residentes del campo pasaron cinco días sacando a los muertos y heridos, dijo.

Nael Al-Bahisi, un paramédico, fue uno de los primeros en llegar al lugar. Contó entre 50 y 70 víctimas ese primer día. «En cierto momento, entendimos que el objetivo del ataque era el comandante de Hamás, Ayman Nofal», dijo al +972 y a Local Call. “Lo mataron a él, y también a mucha gente que no sabía que él estaba allí. Mataron a familias enteras con niños”.

Otra fuente de inteligencia dijo a +972 y Local Call que el ejército destruyó un edificio alto en Rafah a mediados de diciembre, matando a “docenas de civiles”, para intentar matar a Mohammed Shabaneh, el comandante de la Brigada Rafah de Hamas (que no está claro si murió o no en el ataque). A menudo, dijo la fuente, los altos comandantes se esconden en túneles que pasan debajo de edificios civiles y, por lo tanto, la decisión de asesinarlos con un ataque aéreo necesariamente mata a civiles.

«La mayoría de los heridos eran niños», dijo Wael Al-Sir, de 55 años, que presenció el ataque a gran escala que algunos habitantes de Gaza creyeron que había sido un intento de asesinato. Le dijo a +972 y Local Call que el bombardeo del 20 de diciembre destruyó un “bloque residencial entero” y mató al menos a 10 niños.

«Había una política completamente permisiva con respecto a las víctimas de las operaciones [de bombardeo], tan permisiva que en mi opinión tenía un elemento de venganza», afirmó D., una fuente de inteligencia. “El núcleo de esto fueron los asesinatos de altos mandos [de Hamás y de la Yihad Islámica en Palestina] por quienes estaban dispuestos a matar a cientos de civiles. Hicimos un cálculo: cuántos para un comandante de brigada, cuántos para un comandante de batallón, etcétera”.

«Había regulaciones, pero eran muy indulgentes», dijo E., otra fuente de inteligencia. “Hemos matado a personas con daños colaterales de dos dígitos, si no de tres dígitos. Estas son cosas que no habían sucedido antes”.

Una tasa tan alta de “daños colaterales” es excepcional no sólo en comparación con lo que el ejército israelí consideraba aceptable anteriormente, sino también en comparación con las guerras emprendidas por Estados Unidos en Irak, Siria y Afganistán.

El general Peter Gersten, subcomandante de Operaciones e Inteligencia en la operación para luchar contra ISIS en Irak y Siria, dijo a una revista de defensa estadounidense en 2021 que un ataque con daños colaterales a 15 civiles se desvió del procedimiento; para llevarlo a cabo tuvo que obtener un permiso especial del jefe del Comando Central estadounidense, el general Lloyd Austin, que hoy es secretario de Defensa.

«Con Osama Bin Laden, tendrías un NCV [valor de bajas de no combatientes] de 30, pero si tuvieras un comandante de bajo nivel, su NCV normalmente era cero», dijo Gersten. «Hemos estado en cero durante mucho tiempo».

‘Nos dijeron: ‘a todo lo que puedas, bomba»

Todas las fuentes entrevistadas para esta investigación afirmaron que las masacres de Hamás del 7 de octubre y el secuestro de rehenes influyeron mucho en la política de incendios del ejército y en los grados de daños colaterales. «Al principio, el ambiente era doloroso y vengativo», dijo B., quien fue reclutado en el ejército inmediatamente después del 7 de octubre y sirvió en una sala de operaciones de objetivos. “Las reglas eran muy indulgentes. Derribaron cuatro edificios cuando supieron que el objetivo estaba en uno de ellos. Fue loco.

“Hubo una disonancia: por un lado, la gente aquí estaba frustrada porque no estábamos atacando lo suficiente”, continuó B.. “Por otro lado, al final del día se ve que otros mil habitantes de Gaza han muerto, la mayoría de ellos civiles”.

“Había histeria en las filas profesionales”, dijo D., que también fue reclutado inmediatamente después del 7 de octubre. “No tenían ni idea de cómo reaccionar. Lo único que sabían hacer era empezar a bombardear como locos para intentar desmantelar las capacidades de Hamás”.

D. subrayó que no se les dijo explícitamente que el objetivo del ejército era la “venganza”, pero expresó que “tan pronto como cada objetivo relacionado con Hamas se vuelva legítimo y se aprueben casi todos los daños colaterales, quedará claro para ustedes que vais a matar a miles de personas. Incluso si oficialmente todos los objetivos están conectados con Hamás, cuando la política es tan permisiva, pierde todo significado”.

A. también utilizó la palabra “venganza” para describir la atmósfera dentro del ejército después del 7 de octubre. “Nadie pensó en qué hacer después, cuando termine la guerra, o cómo será posible vivir en Gaza y qué harán después», dijo A. “Nos dijeron: ahora tenemos que arruinar a Hamás, cueste lo que cueste. Todo lo que puedas, lo bombardeas”.

B., la principal fuente de inteligencia, dijo que, en retrospectiva, cree que esta política “desproporcionada” de matar a palestinos en Gaza también pone en peligro a los israelíes, y que ésta fue una de las razones por las que decidió ser entrevistado.

“A corto plazo, estamos más seguros porque perjudicamos a Hamás. Pero creo que estamos menos seguros a largo plazo. Veo cómo todas las familias afligidas en Gaza –que son casi todas– aumentarán la motivación para [que la gente se una a] Hamas dentro de 10 años. Y será mucho más fácil para [Hamás] reclutarlos”.

En una declaración a +972 y Local Call, el ejército israelí negó gran parte de lo que nos dijeron las fuentes, afirmando que “cada objetivo se examina individualmente, mientras se hace una evaluación individual de la ventaja militar y los daños colaterales esperados del ataque… El ejercito israelí no lleva a cabo ataques cuando el daño colateral esperado del ataque es excesivo en relación con la ventaja militar”.

PASO 5: CÁLCULO DEL DAÑO COLATERAL

‘El modelo no estaba conectado con la realidad’

Según fuentes de inteligencia, el cálculo por parte del ejército israelí del número de civiles que se espera que mueran en cada casa junto a un objetivo (un procedimiento examinado en una investigación previa por +972 y Local Call) se llevó a cabo con la ayuda de herramientas automáticas e inexactas. . En guerras anteriores, el personal de inteligencia dedicaba mucho tiempo a verificar cuántas personas había en una casa que iba a ser bombardeada, y el número de civiles que podían morir figuraba como parte de un “archivo de objetivos”. Sin embargo, después del 7 de octubre, esta verificación exhaustiva se abandonó en gran medida en favor de la automatización.

En octubre, The New York Times informó sobre un sistema operado desde una base especial en el sur de Israel, que recopila información de teléfonos móviles en la Franja de Gaza y proporcionó a los militares una estimación en tiempo real del número de palestinos que huyeron del norte de la Franja de Gaza hacia el sur. El general Udi Ben Muha dijo al Times que «no es un sistema 100 por ciento perfecto, pero te brinda la información que necesitas para tomar una decisión». El sistema funciona según colores: el rojo marca las zonas donde hay mucha gente, y el verde y el amarillo marcan las zonas que han estado relativamente libres de residentes.

Las fuentes que hablaron con +972 y Local Call describieron un sistema similar para calcular los daños colaterales, que se utilizó para decidir si bombardear un edificio en Gaza. Dijeron que el software calculó el número de civiles que residían en cada casa antes de la guerra (evaluando el tamaño del edificio y revisando su lista de residentes) y luego redujo esos números en la proporción de residentes que supuestamente evacuaron el vecindario.

Por ejemplo, si el ejército estimara que la mitad de los residentes de un barrio se habían ido, el programa contaría una casa que normalmente tenía 10 residentes como una casa que contiene cinco personas. Para ahorrar tiempo, dijeron las fuentes, el ejército no vigiló las casas para comprobar cuántas personas vivían realmente allí, como hizo en operaciones anteriores, para comprobar si las estimaciones del programa eran realmente exactas.

«Este modelo no se correspondía con la realidad», afirmó una fuente. “No había ninguna conexión entre los que estaban en la casa ahora, durante la guerra, y los que figuraban como viviendo allí antes de la guerra. [En una ocasión] bombardeamos una casa sin saber que dentro había varias familias escondidas juntas”.

La fuente dijo que aunque el ejército sabía que tales errores podían ocurrir, de todos modos se adoptó este modelo impreciso porque era más rápido. Como tal, dijo la fuente, “el cálculo de los daños colaterales fue completamente automático y estadístico”, e incluso produjo cifras que no eran números enteros.

PASO 6: BOMBARDEAR UNA CASA FAMILIAR

‘Mataste a una familia sin ningún motivo’

Las fuentes que hablaron con +972 y Local Call explicaron que a veces había una brecha sustancial entre el momento en que sistemas de seguimiento como ¿Dónde está papá? alertó a un oficial de que un objetivo había entrado en su casa y del bombardeo en sí, que provocó la muerte de familias enteras incluso sin alcanzar el objetivo del ejército. «Me pasó muchas veces que atacamos una casa, pero la persona ni siquiera estaba en casa», dijo una fuente. «El resultado es que mataste a una familia sin ningún motivo».

Tres fuentes de inteligencia dijeron a +972 y Local Call que habían sido testigos de un incidente en el que el ejército israelí bombardeó la casa privada de una familia, y más tarde resultó que el objetivo del asesinato ni siquiera estaba dentro de la casa, ya que no se hizo ninguna verificación adicional en tiempo real.

«A veces [el objetivo] estaba en casa más temprano, y luego por la noche se iba a dormir a otro lugar, por ejemplo bajo tierra, y no lo sabías», dijo una de las fuentes. “Hay ocasiones en las que vuelves a verificar la ubicación y hay ocasiones en las que simplemente dices: ‘Está bien, él estuvo en la casa en las últimas horas, así que puedes simplemente bombardear’”.

Otra fuente describió un incidente similar que lo afectó y le hizo querer ser entrevistado para esta investigación. “Entendimos que el objetivo estaba en casa a las 8 de la noche. Al final, la fuerza aérea bombardeó la casa a las 3 de la mañana. Luego descubrimos [en ese lapso de tiempo] que había logrado mudarse a otra casa con su familia. Había otras dos familias con niños en el edificio que bombardeamos”.

En guerras anteriores en Gaza, después del asesinato de objetivos humanos, la inteligencia israelí llevaba a cabo procedimientos de evaluación de daños por bombas (BDA), una verificación de rutina posterior al ataque para ver si el comandante superior murió y cuántos civiles murieron junto con él. Como se reveló en una investigación anterior de +972 y Local Call , esto implicó escuchar llamadas telefónicas de familiares que perdieron a sus seres queridos. Sin embargo, en la guerra actual, al menos en relación con los militantes jóvenes marcados con IA, las fuentes dicen que este procedimiento fue abolido para ahorrar tiempo. Las fuentes dijeron que no sabían cuántos civiles murieron realmente en cada ataque, y en el caso de los presuntos agentes de bajo rango de Hamás y la Jihad Islámica marcados por IA, ni siquiera sabían si el propio objetivo había muerto.

Fuente: https://www.972mag.com/lavender-ai-israeli-army-gaza/

El presente artículo puede reproducirse libremente siempre que se respete su integridad y se nombre a su autor, a su traductora y a Rebelión como fuente de la traducción.